- LINÉAIRE ET MULTILINÉAIRE (ALGÈBRE)

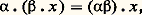

- LINЙAIRE ET MULTILINЙAIRE (ALGИBRE)L’algèbre linéaire sur un corps commutatif, telle qu’on la trouvera présentée ici, s’est progressivement dégagée, au cours du XIXe siècle et au début du XXe, de la théorie des équations linéaires (systèmes de n équations linéaires à p inconnues, équations différentielles et intégrales linéaires) et de la géométrie (calcul vectoriel dans les espaces affines, transformations des espaces projectifs, dualité pour les sous-variétés linéaires et les quadriques, structure même de la géométrie). L’algèbre multilinéaire sur un corps commutatif a pris naissance dans la théorie des invariants et dans la partie de la géométrie différentielle consacrée au calcul tensoriel. Plus récemment, on a développé l’algèbre linéaire sur un anneau afin d’appliquer les méthodes de l’algèbre linéaire sur les corps à la théorie des groupes abéliens, considérés comme Z-modules, à la théorie des entiers algébriques sur un anneau commutatif unitaire, considérés comme éléments d’un module sur cet anneau, à la représentation linéaire d’un groupe dans un espace vectoriel, considéré comme module sur l’algèbre de ce groupe, et à l’étude des formes quadratiques sur Z. Enfin, ces dernières années ont été introduites l’algèbre homologique et, plus généralement, la théorie des catégories abéliennes, permettant d’appliquer la théorie des modules à des domaines où elle semblait inopérante (théorie des fibrés vectoriels et des faisceaux).On trouvera un aperçu historique plus complet dans l’article ALGÈBRE. D’autre part, on trouvera des détails sur les applications de l’algèbre linéaire dans de nombreux articles tels que GROUPES (Mathématiques)-Groupes classiques et géométrie, Groupes de Lie et théorie des NOMBRES - Nombres algébriques. Bien entendu, la liste précédente n’est pas exhaustive: on pourrait, à la limite, affirmer que l’algèbre linéaire a envahi tous les domaines des mathématiques. À titre d’exemple, on consultera les applications à la théorie des équations algébriques (cf. CORPS [Mathématiques]) et à l’analyse fonctionnelle (cf. équations aux DÉRIVÉES PARTIELLES, DISTRIBUTIONS [Mathématiques], algèbres NORMÉES, espaces vectoriels NORMÉS).Dans le présent article sera d’abord exposée la théorie des espaces vectoriels sur un corps commutatif, indépendamment de la notion de dimension. L’explicitation des résultats obtenus lorsque les espaces vectoriels sont de dimension finie et munis de bases fait l’objet du paragraphe consacré au calcul matriciel. Dans cette partie, l’exposé reste élémentaire, et la plupart des théorèmes sont accompagnés de démonstrations. Suivent quelques indications sur l’algèbre tensorielle et la théorie des modules.En ce qui concerne la réduction des endomorphismes et la théorie des formes quadratiques, on se reportera aux articles: théorie SPECTRALE et formes QUADRATIQUES.1. Espaces vectoriels et applications linéairesEspaces vectorielsSoit K un corps commutatif. On appelle espace vectoriel sur K, ou encore K-espace vectoriel, un ensemble E muni de deux lois de composition: une loi interne, application de E 憐 E dans E, notée (x , y ) 料 x + y et une loi externe, application de K 憐 Edans K, notée ( 見, x ) 料 見 練 x , ou encore ( 見, x ) 料 見x ; ces deux lois satisfaisant aux conditions suivantes:(a) L’ensemble E, muni de l’addition, est un groupe commutatif.

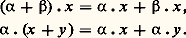

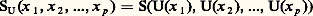

Les éléments de E sont souvent appelés vecteurs , les éléments de K scalaires .Applications linéairesSoit E et F deux espaces vectoriels sur un même corps commutatif K. On dit qu’une application U de E dans F est K-linéaire ou, plus simplement, linéaire si, pour tout couple (x , y ) d’éléments de E et pour tout couple ( 見, 廓) de scalaires:

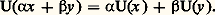

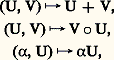

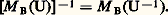

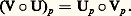

Les éléments de E sont souvent appelés vecteurs , les éléments de K scalaires .Applications linéairesSoit E et F deux espaces vectoriels sur un même corps commutatif K. On dit qu’une application U de E dans F est K-linéaire ou, plus simplement, linéaire si, pour tout couple (x , y ) d’éléments de E et pour tout couple ( 見, 廓) de scalaires: On dit aussi que U est un morphisme d’espaces vectoriels.Soit E, F et G trois espaces vectoriels sur K. Pour toute application linéaire U de E dans F et pour toute application linéaire V de F dans G, l’application composée V 獵 U est linéaire.On dit qu’une application linéaire U de E dans F est un isomorphisme de E sur F s’il existe une application linéaire V de F dans E telle que:

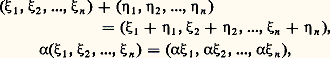

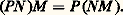

On dit aussi que U est un morphisme d’espaces vectoriels.Soit E, F et G trois espaces vectoriels sur K. Pour toute application linéaire U de E dans F et pour toute application linéaire V de F dans G, l’application composée V 獵 U est linéaire.On dit qu’une application linéaire U de E dans F est un isomorphisme de E sur F s’il existe une application linéaire V de F dans E telle que: Une application linéaire de E dans lui-même s’appelle endomorphisme de E, et un isomorphisme de E sur lui-même automorphisme de E.Voici quelques exemples d’espaces vectoriels et d’applications linéaires:1. Soit n un entier naturel non nul. L’ensemble Kn des suites de n éléments de K, muni des deux lois définies par les formules:

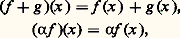

Une application linéaire de E dans lui-même s’appelle endomorphisme de E, et un isomorphisme de E sur lui-même automorphisme de E.Voici quelques exemples d’espaces vectoriels et d’applications linéaires:1. Soit n un entier naturel non nul. L’ensemble Kn des suites de n éléments de K, muni des deux lois définies par les formules: est un espace vectoriel sur K.2. Soit A un ensemble non vide et F un espace vectoriel sur K. L’ensemble A, noté encore 杻(A, F), des applications de A dans F, muni des deux lois définies par les formules:

est un espace vectoriel sur K.2. Soit A un ensemble non vide et F un espace vectoriel sur K. L’ensemble A, noté encore 杻(A, F), des applications de A dans F, muni des deux lois définies par les formules: est un espace vectoriel sur K.3. Soit (Fi )i size=1捻I une famille d’espaces vectoriels sur un même corps commutatif K. L’ensemble produit :

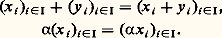

est un espace vectoriel sur K.3. Soit (Fi )i size=1捻I une famille d’espaces vectoriels sur un même corps commutatif K. L’ensemble produit : muni des deux lois suivantes:

muni des deux lois suivantes: est un espace vectoriel sur K, appelé espace vectoriel produit de la famille (Fi )i size=1捻I. (Lorsque tous les espaces vectoriels Fi sont égaux à un même espace vectoriel F, l’espace produit n’est autre que I.) Pour tout élément j de I, le projecteur canonique de l’espace produit sur Fj , qui à toute famille (x i )i size=1捻I associe le vecteur x j , est une application linéaire surjective.4. Soit E un espace vectoriel sur K. On appelle forme linéaire sur E une application linéaire de E dans K, le corps K étant considéré comme espace vectoriel sur lui-même.Par exemple, soit E l’espace vectoriel des fonctions continues sur l’intervalle [0,1] à valeurs complexes. L’application qui à tout élément f de E associe le scalaire:

est un espace vectoriel sur K, appelé espace vectoriel produit de la famille (Fi )i size=1捻I. (Lorsque tous les espaces vectoriels Fi sont égaux à un même espace vectoriel F, l’espace produit n’est autre que I.) Pour tout élément j de I, le projecteur canonique de l’espace produit sur Fj , qui à toute famille (x i )i size=1捻I associe le vecteur x j , est une application linéaire surjective.4. Soit E un espace vectoriel sur K. On appelle forme linéaire sur E une application linéaire de E dans K, le corps K étant considéré comme espace vectoriel sur lui-même.Par exemple, soit E l’espace vectoriel des fonctions continues sur l’intervalle [0,1] à valeurs complexes. L’application qui à tout élément f de E associe le scalaire: est une forme linéaire sur E.Sous-espaces vectorielsSoit E un espace vectoriel sur K, (x i )i size=1捻I une famille de vecteurs de E, ( 見i )i size=1捻 I une famille de scalaires dont le support J est fini. (On appelle support de ( 見i )i size=1捻 I l’ensemble J des éléments i de I tels que 見i 0.) Pour toute partie finie H de I contenant J:

est une forme linéaire sur E.Sous-espaces vectorielsSoit E un espace vectoriel sur K, (x i )i size=1捻I une famille de vecteurs de E, ( 見i )i size=1捻 I une famille de scalaires dont le support J est fini. (On appelle support de ( 見i )i size=1捻 I l’ensemble J des éléments i de I tels que 見i 0.) Pour toute partie finie H de I contenant J: Cette somme se note encore:

Cette somme se note encore: Cette convention permet de poser la définition suivante: On dit qu’un vecteur x de E est combinaison linéaire des vecteurs x i s’il existe une famille ( 見i )i 捻I de scalaires à support fini telle que:

Cette convention permet de poser la définition suivante: On dit qu’un vecteur x de E est combinaison linéaire des vecteurs x i s’il existe une famille ( 見i )i 捻I de scalaires à support fini telle que: Par exemple, soit E l’espace vectoriel des fonctions à valeurs réelles définies sur R, et (f n )n size=1捻N la famille des fonctions monomiales f n : x 料 x n . Les combinaisons linéaires de ces fonctions ne sont autres que les fonctions polynomiales. En revanche, la fonction exponentielle x 料 e x n’est pas combinaison linéaire des fonctions f n .Soit E un espace vectoriel sur K. On dit qu’une partie E de E est un sous-espace vectoriel de E si E est stable pour les deux lois de E et si, munie des lois induites, E est un espace vectoriel sur K.Pour qu’une partie non vide E de E soit un sous-espace vectoriel de E, il faut et il suffit que, pour tout couple (x , y ) d’éléments de E et pour tout couple ( 見, 廓) de scalaires, le vecteur 見x + 廓y appartienne à E .L’intersection d’une famille de sous-espaces vectoriels de E est encore un sous-espace vectoriel de E. Il en découle que, pour toute partie A de E, l’ensemble des sous-espaces vectoriels de E contenant A possède un plus petit élément (au sens de la relation d’inclusion), à savoir l’intersection de tous les sous-espaces vectoriels contenant A. Ce sous-espace vectoriel, dit engendré par A, est encore l’ensemble des combinaisons linéaires d’éléments de A, lorsque A est non vide. Voici quelques exemples.Le sous-espace vectoriel engendré par un vecteur x est noté Kx ; c’est en effet l’ensemble des vecteurs de E de la forme 見x , où 見 appartient à K.Soit E un espace vectoriel sur K et (Ei )i size=1捻 I une famille de sous-espaces vectoriels de E. Le sous-espace vectoriel de E engendré par la réunion des sous-espaces vectoriels Ei est constitué des vecteurs de E de la forme:

Par exemple, soit E l’espace vectoriel des fonctions à valeurs réelles définies sur R, et (f n )n size=1捻N la famille des fonctions monomiales f n : x 料 x n . Les combinaisons linéaires de ces fonctions ne sont autres que les fonctions polynomiales. En revanche, la fonction exponentielle x 料 e x n’est pas combinaison linéaire des fonctions f n .Soit E un espace vectoriel sur K. On dit qu’une partie E de E est un sous-espace vectoriel de E si E est stable pour les deux lois de E et si, munie des lois induites, E est un espace vectoriel sur K.Pour qu’une partie non vide E de E soit un sous-espace vectoriel de E, il faut et il suffit que, pour tout couple (x , y ) d’éléments de E et pour tout couple ( 見, 廓) de scalaires, le vecteur 見x + 廓y appartienne à E .L’intersection d’une famille de sous-espaces vectoriels de E est encore un sous-espace vectoriel de E. Il en découle que, pour toute partie A de E, l’ensemble des sous-espaces vectoriels de E contenant A possède un plus petit élément (au sens de la relation d’inclusion), à savoir l’intersection de tous les sous-espaces vectoriels contenant A. Ce sous-espace vectoriel, dit engendré par A, est encore l’ensemble des combinaisons linéaires d’éléments de A, lorsque A est non vide. Voici quelques exemples.Le sous-espace vectoriel engendré par un vecteur x est noté Kx ; c’est en effet l’ensemble des vecteurs de E de la forme 見x , où 見 appartient à K.Soit E un espace vectoriel sur K et (Ei )i size=1捻 I une famille de sous-espaces vectoriels de E. Le sous-espace vectoriel de E engendré par la réunion des sous-espaces vectoriels Ei est constitué des vecteurs de E de la forme: où, pour tout élément i de I, x i appartient à Ei , et où la famille (x i )i size=1捻 I est à support fini. Ce sous-espace vectoriel s’appelle aussi somme des sous-espaces vectoriels Ei , et se note:

où, pour tout élément i de I, x i appartient à Ei , et où la famille (x i )i size=1捻 I est à support fini. Ce sous-espace vectoriel s’appelle aussi somme des sous-espaces vectoriels Ei , et se note: Dans le cas particulier où I =1, 2, la somme des sous-espaces vectoriels E1 et E2 se note E1 + E2.Espaces vectoriels d’applications linéairesSoit E et F deux espaces vectoriels sur K. L’ensemble des applications linéaires de E dans F est un sous-espace vectoriel, noté 硫(E, F), de l’espace vectoriel 杻(E, F) des applications de E dans F.Soit E, F et G trois espaces vectoriels sur K. L’application V 料 V 獵 U est une application linéaire de 硫(F, G) dans 硫(E, G), et l’application U 料 V 獵 U une application linéaire de 硫(E, F) dans 硫(E, G).En particulier, l’ensemble des endomorphismes d’un espace vectoriel E, muni des trois lois de composition:

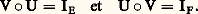

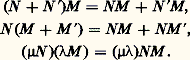

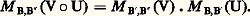

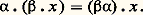

Dans le cas particulier où I =1, 2, la somme des sous-espaces vectoriels E1 et E2 se note E1 + E2.Espaces vectoriels d’applications linéairesSoit E et F deux espaces vectoriels sur K. L’ensemble des applications linéaires de E dans F est un sous-espace vectoriel, noté 硫(E, F), de l’espace vectoriel 杻(E, F) des applications de E dans F.Soit E, F et G trois espaces vectoriels sur K. L’application V 料 V 獵 U est une application linéaire de 硫(F, G) dans 硫(E, G), et l’application U 料 V 獵 U une application linéaire de 硫(E, F) dans 硫(E, G).En particulier, l’ensemble des endomorphismes d’un espace vectoriel E, muni des trois lois de composition: est une algèbre associative unitaire, notée 硫(E) [cf. ANNEAUX ET ALGÈBRES]. Le produit V size=1獵 U se note encore VU.Les automorphismes de E constituent un groupe multiplicatif, appelé groupe linéaire de E, et noté GL(E); c’est le groupe multiplicatif des éléments inversibles de l’anneau unitaire 硫(E).Factorisation des applications linéairesSoit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F. L’image d’un sous-espace vectoriel de E par U est un sous-espace vectoriel de F. En particulier, l’image de E par U est un sous-espace vectoriel de F, appelé aussi image de U, et noté Im(U). De même, l’image réciproque d’un sous-espace vectoriel de F par U est un sous-espace vectoriel de E. En particulier, l’image réciproque du sous-espace vectoriel réduit au vecteur nul de F est un sous-espace vectoriel de E, appelé noyau de U, et noté Ker(U). Pour que U soit injective, il faut et il suffit que son noyau soit réduit au vecteur nul de E.Théorème 1 (théorème de factorisation). Soit E, F et G: trois espaces vectoriels sur K.1. Soit U une application linéaire surjective de E sur F. Pour toute application linéaire V de E dans G telle que Ker(V) contienne Ker(U), il existe une application linéaire W et une seule de F dans G telle que V = W 獵 U. Plus précisément, l’application W 料 W 獵 U est un isomorphisme de l’espace vectoriel 硫(F, G) sur le sous-espace vectoriel de 硫(E, G) constitué des applications linéaires dont le noyau contient celui de U.2. Soit U une application linéaire injective de F dans G. Pour toute application linéaire V de E dans G telle que Im(V) soit contenue dans Im(U), il existe une application linéaire W et une seule de E dans F telle que V = U 獵 W. Plus précisément, l’application W 料 W 獵 U est un isomorphisme de l’espace vectoriel 硫(E, F) sur le sous-espace vectoriel de 硫(E, G) constitué des applications linéaires dont l’image est contenue dans celle de U.Espaces vectoriels quotientsSoit E un sous-espace vectoriel d’un espace vectoriel E. La relation binaire dans E définie par les couples (x , y ) tels que x 漣 y appartienne à E est compatible avec les lois de E. Muni des lois quotients, l’ensemble quotient est un espace vectoriel sur K, appelé espace vectoriel quotient de E par E , et noté E/E . L’application canonique 﨏 de E sur E/E est linéaire, et son noyau est E .Le théorème de factorisation montre aussitôt que le couple (E/E , 﨏) possède la propriété universelle suivante:Pour tout couple (F, U) constitué d’un espace vectoriel F sur K et d’une application linéaire U de E dans F dont le noyau contient E , il existe une application linéaire U 黎 et une seule de E/E dans F telle que U = U 黎 獵 﨏. Plus précisément, l’application V 料 V 獵 﨏 est un isomorphisme de l’espace vectoriel 硫(E/E , F) sur le sous-espace vectoriel de 硫(E, F) constitué des applications linéaires de E dans F dont le noyau contient E .Voici une conséquence immédiate de la propriété universelle des espaces vectoriels quotients: Soit E et F deux espaces vectoriels sur K, soit U une application linéaire de E dans F, soit 﨏 l’application canonique de E sur E/Ker(U), soit V l’unique application de E/Ker(U) dans Im(U) telle que U(x ) = (V 獵 﨏)(x ), pour tout vecteur x de E, et soit i l’injection canonique de Im(U) dans F. Alors V est un isomorphisme de E/Ker(U) sur Im(U), et:

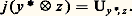

est une algèbre associative unitaire, notée 硫(E) [cf. ANNEAUX ET ALGÈBRES]. Le produit V size=1獵 U se note encore VU.Les automorphismes de E constituent un groupe multiplicatif, appelé groupe linéaire de E, et noté GL(E); c’est le groupe multiplicatif des éléments inversibles de l’anneau unitaire 硫(E).Factorisation des applications linéairesSoit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F. L’image d’un sous-espace vectoriel de E par U est un sous-espace vectoriel de F. En particulier, l’image de E par U est un sous-espace vectoriel de F, appelé aussi image de U, et noté Im(U). De même, l’image réciproque d’un sous-espace vectoriel de F par U est un sous-espace vectoriel de E. En particulier, l’image réciproque du sous-espace vectoriel réduit au vecteur nul de F est un sous-espace vectoriel de E, appelé noyau de U, et noté Ker(U). Pour que U soit injective, il faut et il suffit que son noyau soit réduit au vecteur nul de E.Théorème 1 (théorème de factorisation). Soit E, F et G: trois espaces vectoriels sur K.1. Soit U une application linéaire surjective de E sur F. Pour toute application linéaire V de E dans G telle que Ker(V) contienne Ker(U), il existe une application linéaire W et une seule de F dans G telle que V = W 獵 U. Plus précisément, l’application W 料 W 獵 U est un isomorphisme de l’espace vectoriel 硫(F, G) sur le sous-espace vectoriel de 硫(E, G) constitué des applications linéaires dont le noyau contient celui de U.2. Soit U une application linéaire injective de F dans G. Pour toute application linéaire V de E dans G telle que Im(V) soit contenue dans Im(U), il existe une application linéaire W et une seule de E dans F telle que V = U 獵 W. Plus précisément, l’application W 料 W 獵 U est un isomorphisme de l’espace vectoriel 硫(E, F) sur le sous-espace vectoriel de 硫(E, G) constitué des applications linéaires dont l’image est contenue dans celle de U.Espaces vectoriels quotientsSoit E un sous-espace vectoriel d’un espace vectoriel E. La relation binaire dans E définie par les couples (x , y ) tels que x 漣 y appartienne à E est compatible avec les lois de E. Muni des lois quotients, l’ensemble quotient est un espace vectoriel sur K, appelé espace vectoriel quotient de E par E , et noté E/E . L’application canonique 﨏 de E sur E/E est linéaire, et son noyau est E .Le théorème de factorisation montre aussitôt que le couple (E/E , 﨏) possède la propriété universelle suivante:Pour tout couple (F, U) constitué d’un espace vectoriel F sur K et d’une application linéaire U de E dans F dont le noyau contient E , il existe une application linéaire U 黎 et une seule de E/E dans F telle que U = U 黎 獵 﨏. Plus précisément, l’application V 料 V 獵 﨏 est un isomorphisme de l’espace vectoriel 硫(E/E , F) sur le sous-espace vectoriel de 硫(E, F) constitué des applications linéaires de E dans F dont le noyau contient E .Voici une conséquence immédiate de la propriété universelle des espaces vectoriels quotients: Soit E et F deux espaces vectoriels sur K, soit U une application linéaire de E dans F, soit 﨏 l’application canonique de E sur E/Ker(U), soit V l’unique application de E/Ker(U) dans Im(U) telle que U(x ) = (V 獵 﨏)(x ), pour tout vecteur x de E, et soit i l’injection canonique de Im(U) dans F. Alors V est un isomorphisme de E/Ker(U) sur Im(U), et: formule de décomposition canonique de U, qui ramène en quelque sorte l’étude de U à celles de i , de 﨏 et de V.DualitéSoit E un espace vectoriel sur K. L’espace vectoriel 硫(E, K) des formes linéaires sur E s’appelle espace vectoriel dual de E, et se note E. L’application de E 憐 E dans K, qui au couple (y , x ) associe le scalaire y (x ), est une forme bilinéaire (cf. Bases ), dite canonique, et encore notée:

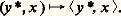

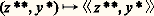

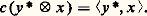

formule de décomposition canonique de U, qui ramène en quelque sorte l’étude de U à celles de i , de 﨏 et de V.DualitéSoit E un espace vectoriel sur K. L’espace vectoriel 硫(E, K) des formes linéaires sur E s’appelle espace vectoriel dual de E, et se note E. L’application de E 憐 E dans K, qui au couple (y , x ) associe le scalaire y (x ), est une forme bilinéaire (cf. Bases ), dite canonique, et encore notée: Le dual de l’espace vectoriel E, c’est-à-dire l’espace vectoriel des formes linéaires sur E, s’appelle bidual de E, et se note E. Pour éviter des confusions, nous noterons:

Le dual de l’espace vectoriel E, c’est-à-dire l’espace vectoriel des formes linéaires sur E, s’appelle bidual de E, et se note E. Pour éviter des confusions, nous noterons: la forme bilinéaire canonique sur E 憐 E..Étant donné un vecteur x de E, l’application de E dans K, qui à toute forme linéaire y sur E associe le scalaire 麗y , x 礪, est une forme linéaire sur E; c’est donc un élément de E. L’application 﨑, qui associe au vecteur x cet élément de E, est une application linéaire de E dans E, dite canonique; elle est définie par la relation:

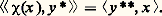

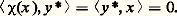

la forme bilinéaire canonique sur E 憐 E..Étant donné un vecteur x de E, l’application de E dans K, qui à toute forme linéaire y sur E associe le scalaire 麗y , x 礪, est une forme linéaire sur E; c’est donc un élément de E. L’application 﨑, qui associe au vecteur x cet élément de E, est une application linéaire de E dans E, dite canonique; elle est définie par la relation: On dit qu’un vecteur x de E et une forme linéaire y sur E sont orthogonaux si 麗y , x 礪 = 0. On dit qu’une partie A de E et une partie B de E sont orthogonales si, pour tout élément x de A et pour tout élément y de B, x et y sont orthogonaux. L’ensemble des éléments de E orthogonaux à un sous-espace vectoriel F de E est un sous-espace vectoriel de E, appelé orthogonal de F, et noté F size=1旅. De même, l’ensemble des vecteurs de E orthogonaux à un sous-espace vectoriel G de E est un sous-espace vectoriel de E, appelé orthogonal de G, et noté G .Théorème 2 . Soit E et F deux espaces vectoriels sur K, soit E et F leurs duaux, et U une application linéaire de E dans F. Il existe une application linéaire de F dans E et une seule, appelée transposée de U et noté t U, telle que, pour tout élément x de E et pour tout élément y de F,

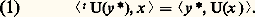

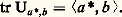

On dit qu’un vecteur x de E et une forme linéaire y sur E sont orthogonaux si 麗y , x 礪 = 0. On dit qu’une partie A de E et une partie B de E sont orthogonales si, pour tout élément x de A et pour tout élément y de B, x et y sont orthogonaux. L’ensemble des éléments de E orthogonaux à un sous-espace vectoriel F de E est un sous-espace vectoriel de E, appelé orthogonal de F, et noté F size=1旅. De même, l’ensemble des vecteurs de E orthogonaux à un sous-espace vectoriel G de E est un sous-espace vectoriel de E, appelé orthogonal de G, et noté G .Théorème 2 . Soit E et F deux espaces vectoriels sur K, soit E et F leurs duaux, et U une application linéaire de E dans F. Il existe une application linéaire de F dans E et une seule, appelée transposée de U et noté t U, telle que, pour tout élément x de E et pour tout élément y de F, L’aplication t U n’est autre que l’application y 料 y 獵 U. La relation (1) s’appelle identité fondamentale de la transposition.La transposée de l’application identique de E n’est autre que l’application identique de son dual:

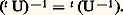

L’aplication t U n’est autre que l’application y 料 y 獵 U. La relation (1) s’appelle identité fondamentale de la transposition.La transposée de l’application identique de E n’est autre que l’application identique de son dual: Soit E, F et G trois espaces vectoriels sur K, soit U une application linéaire de E dans F, et V une application linéaire de F dans G. Alors la transposée de V 獵 U est égale à t U 獵 t V. En particulier, si G = E, et si U est inversible à gauche (resp. à droite), t U est inversible à droite (resp. à gauche). Plus particulièrement encore, si U est un isomorphisme de E sur F, t U est un isomorphisme de F sur E, et:

Soit E, F et G trois espaces vectoriels sur K, soit U une application linéaire de E dans F, et V une application linéaire de F dans G. Alors la transposée de V 獵 U est égale à t U 獵 t V. En particulier, si G = E, et si U est inversible à gauche (resp. à droite), t U est inversible à droite (resp. à gauche). Plus particulièrement encore, si U est un isomorphisme de E sur F, t U est un isomorphisme de F sur E, et: L’isomorphisme de E sur F ainsi défini s’appelle contragrédient de U, et se note face="EU Caron" U. Lorsque F = E, l’application U 料 face="EU Caron" U est un morphisme du groupe GL(E) dans le groupe GL(E).Enfin, pour toute application linéaire U de E dans F, le noyau de t U n’est autre que l’orthogonal dans F de l’image de U:

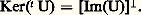

L’isomorphisme de E sur F ainsi défini s’appelle contragrédient de U, et se note face="EU Caron" U. Lorsque F = E, l’application U 料 face="EU Caron" U est un morphisme du groupe GL(E) dans le groupe GL(E).Enfin, pour toute application linéaire U de E dans F, le noyau de t U n’est autre que l’orthogonal dans F de l’image de U: Équations linéairesSoit E et F deux espaces vectoriels sur K, soit U une application linéaire de E dans F, et b un élément de F. On appelle équation linéaire définie par U et b l’équation:

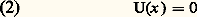

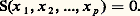

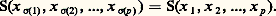

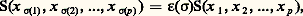

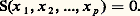

Équations linéairesSoit E et F deux espaces vectoriels sur K, soit U une application linéaire de E dans F, et b un élément de F. On appelle équation linéaire définie par U et b l’équation: Le vecteur b s’appelle second membre de l’équation (1). Lorsque b = 0, on dit que l’équation (1) est homogène, ou, par abus de langage, sans second membre. L’équation:

Le vecteur b s’appelle second membre de l’équation (1). Lorsque b = 0, on dit que l’équation (1) est homogène, ou, par abus de langage, sans second membre. L’équation: s’appelle équation linéaire homogène associée à l’équation (1).Voici les propriétés de l’ensemble des solutions d’une équation linéaire.Si l’équation linéaire (1) est homogène, ses solutions constituent un sous-espace vectoriel de E, à savoir le noyau de U. Dans le cas général, si l’équation (1) admet une solution x 0, on obtient toutes les solutions de cette équation en ajoutant à x 0 une solution quelconque de l’équation homogène associée.Enfin, pour que l’équation (1) admette une solution et une seule quel que soit le second membre b , il faut et il suffit que l’application linéaire U soit bijective, ou encore que sa transposée t U le soit. Dans ces conditions, l’unique solution de l’équation (1) n’est autre que U-1(b ); l’application de F dans E, qui à tout vecteur b associe cette solution, est donc linéaire. On dit aussi que la solution dépend linéairement du second membre.On voit donc que les notions d’image et de noyau sont fondamentales pour l’étude des équations linéaires.2. Sommes directes, basesSommes directesSoit (Ei )i size=1捻 I une famille d’espaces vectoriels sur K. Dans l’espace vectoriel:

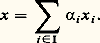

s’appelle équation linéaire homogène associée à l’équation (1).Voici les propriétés de l’ensemble des solutions d’une équation linéaire.Si l’équation linéaire (1) est homogène, ses solutions constituent un sous-espace vectoriel de E, à savoir le noyau de U. Dans le cas général, si l’équation (1) admet une solution x 0, on obtient toutes les solutions de cette équation en ajoutant à x 0 une solution quelconque de l’équation homogène associée.Enfin, pour que l’équation (1) admette une solution et une seule quel que soit le second membre b , il faut et il suffit que l’application linéaire U soit bijective, ou encore que sa transposée t U le soit. Dans ces conditions, l’unique solution de l’équation (1) n’est autre que U-1(b ); l’application de F dans E, qui à tout vecteur b associe cette solution, est donc linéaire. On dit aussi que la solution dépend linéairement du second membre.On voit donc que les notions d’image et de noyau sont fondamentales pour l’étude des équations linéaires.2. Sommes directes, basesSommes directesSoit (Ei )i size=1捻 I une famille d’espaces vectoriels sur K. Dans l’espace vectoriel: l’ensemble des éléments (x i )i 捻I à support fini est un sous-espace vectoriel de cet espace vectoriel, appelé somme directe de la famille (Ei )i size=1捻 I, et noté:

l’ensemble des éléments (x i )i 捻I à support fini est un sous-espace vectoriel de cet espace vectoriel, appelé somme directe de la famille (Ei )i size=1捻 I, et noté: il coïncide avec l’espace vectoriel produit lorsque l’ensemble I est fini.Soit, en particulier, E un espace vectoriel sur K, soit (Ei )i size=1捻 I une famille de sous-espaces vectoriels de E, et U l’application linéaire de la somme directe de cette famille dans E qui à tout élément (x i )i size=1捻 I associe l’élément:

il coïncide avec l’espace vectoriel produit lorsque l’ensemble I est fini.Soit, en particulier, E un espace vectoriel sur K, soit (Ei )i size=1捻 I une famille de sous-espaces vectoriels de E, et U l’application linéaire de la somme directe de cette famille dans E qui à tout élément (x i )i size=1捻 I associe l’élément: Alors l’image de U est la somme:

Alors l’image de U est la somme: des sous-espaces vectoriels Ei , et le noyau de U est l’ensemble des éléments (x i )i size=1捻 I tels que:

des sous-espaces vectoriels Ei , et le noyau de U est l’ensemble des éléments (x i )i size=1捻 I tels que: Ainsi, pour que U soit surjective, il faut et il suffit que:

Ainsi, pour que U soit surjective, il faut et il suffit que: et, pour que U soit injective, il faut et il suffit que, pour tout i 捻 I:

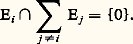

et, pour que U soit injective, il faut et il suffit que, pour tout i 捻 I: Lorsque ces deux conditions sont réalisées, c’est-à-dire lorsque U est un isomorphisme, il est d’usage d’identifier E et:

Lorsque ces deux conditions sont réalisées, c’est-à-dire lorsque U est un isomorphisme, il est d’usage d’identifier E et: ce qui conduit à dire que E est somme directe des sous-espaces vectoriels Ei .Enfin, pour que E soit somme directe des sous-espaces vectoriels Ei , il faut et il suffit que tout vecteur x de E s’écrive d’une manière et d’une seule sous la forme:

ce qui conduit à dire que E est somme directe des sous-espaces vectoriels Ei .Enfin, pour que E soit somme directe des sous-espaces vectoriels Ei , il faut et il suffit que tout vecteur x de E s’écrive d’une manière et d’une seule sous la forme: L’intérêt de la notion de somme directe apparaît dans le théorème suivant.Théorème 3. Soit E et F deux espaces vectoriels sur K, et (Ej )j size=1殮 J une famille de sous-espaces vectoriels de E dont E est somme directe.1. Pour tout élément (Uj )j size=1捻 J de:

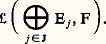

L’intérêt de la notion de somme directe apparaît dans le théorème suivant.Théorème 3. Soit E et F deux espaces vectoriels sur K, et (Ej )j size=1殮 J une famille de sous-espaces vectoriels de E dont E est somme directe.1. Pour tout élément (Uj )j size=1捻 J de: il existe une application linéaire U et une seule de E dans F telle que, pour tout élément j de J, la restriction de U à Ej soit égale à Uj . À tout vecteur x de E, écrit sous la forme:

il existe une application linéaire U et une seule de E dans F telle que, pour tout élément j de J, la restriction de U à Ej soit égale à Uj . À tout vecteur x de E, écrit sous la forme:

2. L’application (Uj )j size=1捻 J 料 U est un isomorphisme de l’espace vectoriel:

2. L’application (Uj )j size=1捻 J 料 U est un isomorphisme de l’espace vectoriel: sur l’espace vectoriel:

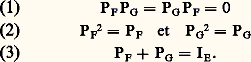

sur l’espace vectoriel: En particulier, deux applications linéaires de E dans F ayant, pour tout élément j de J, même restriction au sous-espace vectoriel Ej sont égales.Sous-espaces vectoriels supplémentaires, projecteursOn dit que deux sous-espaces vectoriels F et G d’un espace vectoriel E sur K sont supplémentaires dans E si les trois conditions équivalentes suivantes sont vérifiées:(a) L’espace vectoriel E est somme directe de F et de G.(b) Tout vecteur x de E s’écrit d’une manière et d’une seule sous la forme x = y + z , où y 捻 F et z 捻 G.(c) La réunion de F et de G engendre E, et l’intersection de F et de G est réduite au vecteur nul.L’application PF qui associe au vecteur x le vecteur y est un endomorphisme de E, appelé projecteur sur F parallèlement à G. Le vecteur y est appelé projection de x sur F parallèlement à G. On définit de même PG.Le projecteur PF a pour image F et pour noyau G, et les endomorphismes PF et PG satisfont aux relations:

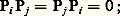

En particulier, deux applications linéaires de E dans F ayant, pour tout élément j de J, même restriction au sous-espace vectoriel Ej sont égales.Sous-espaces vectoriels supplémentaires, projecteursOn dit que deux sous-espaces vectoriels F et G d’un espace vectoriel E sur K sont supplémentaires dans E si les trois conditions équivalentes suivantes sont vérifiées:(a) L’espace vectoriel E est somme directe de F et de G.(b) Tout vecteur x de E s’écrit d’une manière et d’une seule sous la forme x = y + z , où y 捻 F et z 捻 G.(c) La réunion de F et de G engendre E, et l’intersection de F et de G est réduite au vecteur nul.L’application PF qui associe au vecteur x le vecteur y est un endomorphisme de E, appelé projecteur sur F parallèlement à G. Le vecteur y est appelé projection de x sur F parallèlement à G. On définit de même PG.Le projecteur PF a pour image F et pour noyau G, et les endomorphismes PF et PG satisfont aux relations: Les seules relations PF + PG = IE et PF2 = PF impliquent les relations (1) à (3). En effet PFPG = PF(IE 漣 PF) = PF 漣 PF2 = 0; de même, PGPF = 0; enfin:

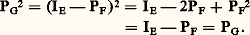

Les seules relations PF + PG = IE et PF2 = PF impliquent les relations (1) à (3). En effet PFPG = PF(IE 漣 PF) = PF 漣 PF2 = 0; de même, PGPF = 0; enfin: C’est pourquoi on dit qu’un endomorphisme U de E est un projecteur si U2 = U. L’endomorphisme U est alors le projecteur sur Im(U) parallèlement à Ker(U).Par exemple, dans l’espace vectoriel 杻(A, K) des applications d’un ensemble A dans K, le sous-espace vectoriel F des applications nulles en un point donné a de A et le sous-espace vectoriel G des applications constantes sont supplémentaires. Le projecteur sur G parallèlement à F est l’application f 料 f (a ).De même, dans l’espace vectoriel sur C des fonctions n fois continûment dérivables sur R à valeurs complexes, le sous-espace vectoriel F des fonctions polynomiales de degré inférieur ou égal à n et le sous-espace vectoriel G constitué des fonctions f telles que, pour tout p 捻 [0, n ], (Dp f )(0) = 0 sont supplémentaires. Le projecteur sur F parallèlement à G n’est autre que l’application qui à toute fonction associe son développement limité à l’ordre n au point 0.Soit enfin E un espace vectoriel sur K et (Ei )i size=1捻 I une famille de sous-espaces vectoriels de E dont E est somme directe. Pout tout élément i de I, l’application Pi qui associe au vecteur x sa i -ième composante x i est le projecteur sur Ei parallèlement à:

C’est pourquoi on dit qu’un endomorphisme U de E est un projecteur si U2 = U. L’endomorphisme U est alors le projecteur sur Im(U) parallèlement à Ker(U).Par exemple, dans l’espace vectoriel 杻(A, K) des applications d’un ensemble A dans K, le sous-espace vectoriel F des applications nulles en un point donné a de A et le sous-espace vectoriel G des applications constantes sont supplémentaires. Le projecteur sur G parallèlement à F est l’application f 料 f (a ).De même, dans l’espace vectoriel sur C des fonctions n fois continûment dérivables sur R à valeurs complexes, le sous-espace vectoriel F des fonctions polynomiales de degré inférieur ou égal à n et le sous-espace vectoriel G constitué des fonctions f telles que, pour tout p 捻 [0, n ], (Dp f )(0) = 0 sont supplémentaires. Le projecteur sur F parallèlement à G n’est autre que l’application qui à toute fonction associe son développement limité à l’ordre n au point 0.Soit enfin E un espace vectoriel sur K et (Ei )i size=1捻 I une famille de sous-espaces vectoriels de E dont E est somme directe. Pout tout élément i de I, l’application Pi qui associe au vecteur x sa i -ième composante x i est le projecteur sur Ei parallèlement à: La famille des projecteurs Pi satisfait aux relations suivantes:

La famille des projecteurs Pi satisfait aux relations suivantes: – Pour tout élément i de I,

– Pour tout élément i de I, – L’application identique de E est égale à la somme des projecteurs Pi .Une famille (Pi )i size=1捻 I de projecteurs de E satisfaisant aux trois conditions précédentes s’appelle système de projecteurs.L’intérêt de la notion de sous-espaces vectoriels supplémentaires apparaît dans le théorème fondamental suivant.Théorème 4. Soit E et F deux espaces vectoriels sur K, U une application linéaire de E dans F, E un sous-espace vectoriel de E, et U la restriction de U à E . Pour que U définisse un isomorphisme de E sur Im(U), il faut et il suffit que E soit un sous-espace vectoriel supplémentaire de Ker(U).Soit en particulier E1 un sous-espace vectoriel d’un espace vectoriel E sur K. Pour tout sous-espace vectoriel E2 supplémentaire de E1 dans E, la restriction à E2 de l’application linéaire canonique de E sur E/E1 est un isomorphisme de E2 sur E/E1. (Il suffit d’appliquer le théorème précédent au cas où F = E/E1, où U est l’application linéaire canonique de E sur E/E1, et où E = E2.)Soit enfin E2 et E 2 deux sous-espaces vectoriels supplémentaires de E1 dans E. La restriction à E2 du projecteur sur E 2 parallèlement à E1 définit un isomorphisme de E2 sur E 2. (Il suffit cette fois d’appliquer le théorème précédent au cas où F = E 2, où U est le projecteur sur E 2 parallèlement à E1, et où E = E2.)Ainsi, deux sous-espaces vectoriels supplémentaires d’une même troisième sont canoniquement isomorphes.BasesSoit KI l’espace vectoriel des applications d’un ensemble non vide I dans K. L’ensemble, noté K(I), des applications de I dans K à support fini est un sous-espace vectoriel de KI; il est égal à KI si I est fini.En particulier, prenons pour I l’ensemble N des entiers naturels. Alors KN est l’espace vectoriel des séries formelles à coefficients dans K, tandis que K(N) est l’espace vectoriel des polynômes à coefficients dans K.On notera que:

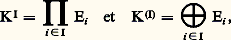

– L’application identique de E est égale à la somme des projecteurs Pi .Une famille (Pi )i size=1捻 I de projecteurs de E satisfaisant aux trois conditions précédentes s’appelle système de projecteurs.L’intérêt de la notion de sous-espaces vectoriels supplémentaires apparaît dans le théorème fondamental suivant.Théorème 4. Soit E et F deux espaces vectoriels sur K, U une application linéaire de E dans F, E un sous-espace vectoriel de E, et U la restriction de U à E . Pour que U définisse un isomorphisme de E sur Im(U), il faut et il suffit que E soit un sous-espace vectoriel supplémentaire de Ker(U).Soit en particulier E1 un sous-espace vectoriel d’un espace vectoriel E sur K. Pour tout sous-espace vectoriel E2 supplémentaire de E1 dans E, la restriction à E2 de l’application linéaire canonique de E sur E/E1 est un isomorphisme de E2 sur E/E1. (Il suffit d’appliquer le théorème précédent au cas où F = E/E1, où U est l’application linéaire canonique de E sur E/E1, et où E = E2.)Soit enfin E2 et E 2 deux sous-espaces vectoriels supplémentaires de E1 dans E. La restriction à E2 du projecteur sur E 2 parallèlement à E1 définit un isomorphisme de E2 sur E 2. (Il suffit cette fois d’appliquer le théorème précédent au cas où F = E 2, où U est le projecteur sur E 2 parallèlement à E1, et où E = E2.)Ainsi, deux sous-espaces vectoriels supplémentaires d’une même troisième sont canoniquement isomorphes.BasesSoit KI l’espace vectoriel des applications d’un ensemble non vide I dans K. L’ensemble, noté K(I), des applications de I dans K à support fini est un sous-espace vectoriel de KI; il est égal à KI si I est fini.En particulier, prenons pour I l’ensemble N des entiers naturels. Alors KN est l’espace vectoriel des séries formelles à coefficients dans K, tandis que K(N) est l’espace vectoriel des polynômes à coefficients dans K.On notera que: où, pour tout élément i de I, Ei = K. Par suite, l’espace vectoriel K(I) est somme directe des sous-espaces vectoriels Ke i , où pour tout élément i de I, e i est l’élément de K(I) défini par les formules e i (j ) = 嗀ij . Autrement dit, tout élément f de K(I) s’écrit d’une manière et d’une seule sous la forme:

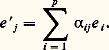

où, pour tout élément i de I, Ei = K. Par suite, l’espace vectoriel K(I) est somme directe des sous-espaces vectoriels Ke i , où pour tout élément i de I, e i est l’élément de K(I) défini par les formules e i (j ) = 嗀ij . Autrement dit, tout élément f de K(I) s’écrit d’une manière et d’une seule sous la forme: Théorème 5. Le couple (K(I), (e i )i size=1捻 I) possède la propriété universelle suivante: Pour tout couple (E, (x i )i size=1捻 I) constitué d’un espace vectoriel E sur K et d’une famille (x i )i size=1捻 I de vecteurs de E, il existe une application linéaire U et une seule de K(I) dans E telle que, pour tout élément i de I, U(e i ) = x i . L’application U associe à tout élément f = ( 見i )i size=1捻 I le vecteur:

Théorème 5. Le couple (K(I), (e i )i size=1捻 I) possède la propriété universelle suivante: Pour tout couple (E, (x i )i size=1捻 I) constitué d’un espace vectoriel E sur K et d’une famille (x i )i size=1捻 I de vecteurs de E, il existe une application linéaire U et une seule de K(I) dans E telle que, pour tout élément i de I, U(e i ) = x i . L’application U associe à tout élément f = ( 見i )i size=1捻 I le vecteur: L’image de U est le sous-espace vectoriel de E engendré par les vecteurs x i , et le noyau de U est l’ensemble des éléments ( 見i )i size=1捻 I tels que:

L’image de U est le sous-espace vectoriel de E engendré par les vecteurs x i , et le noyau de U est l’ensemble des éléments ( 見i )i size=1捻 I tels que: Les éléments de ce noyau sont appelés relations linéaires entre les vecteurs x i ; en particulier, le vecteur nul de K(I) est appelé relation linéaire triviale entre ces vecteurs.Ainsi, pour que U soit surjective, il faut et il suffit que tout vecteur x de E soit une combinaison linéaire des vecteurs x i . On dit alors que la famille (x i )i size=1捻 I est génératrice . Pour que U soit injective, il faut et il suffit que toute relation linéaire entre les vecteurs x i soit triviale. On dit alors que la famille (x i )i size=1捻 I est libre . Lorsque ces deux conditions sont réalisées, c’est-à-dire lorsque U est un isomorphisme de K(I) sur E, on dit que la famille (x i )i size=1捻 I est une base de E. Cela revient à dire que tout vecteur x de E peut s’écrire d’une manière et d’une seule sous la forme:

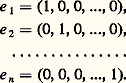

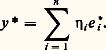

Les éléments de ce noyau sont appelés relations linéaires entre les vecteurs x i ; en particulier, le vecteur nul de K(I) est appelé relation linéaire triviale entre ces vecteurs.Ainsi, pour que U soit surjective, il faut et il suffit que tout vecteur x de E soit une combinaison linéaire des vecteurs x i . On dit alors que la famille (x i )i size=1捻 I est génératrice . Pour que U soit injective, il faut et il suffit que toute relation linéaire entre les vecteurs x i soit triviale. On dit alors que la famille (x i )i size=1捻 I est libre . Lorsque ces deux conditions sont réalisées, c’est-à-dire lorsque U est un isomorphisme de K(I) sur E, on dit que la famille (x i )i size=1捻 I est une base de E. Cela revient à dire que tout vecteur x de E peut s’écrire d’une manière et d’une seule sous la forme: La famille ( 見i )i size=1捻 I s’appelle famille des composantes du vecteur x dans la base (x i )i size=1捻 I.Par exemple, la famille (e i )i size=1捻 I est une base, dite canonique, de K(I). En particulier, lorsque I = [1, n ], la base canonique de Kn est constituée des n vecteurs suivants:

La famille ( 見i )i size=1捻 I s’appelle famille des composantes du vecteur x dans la base (x i )i size=1捻 I.Par exemple, la famille (e i )i size=1捻 I est une base, dite canonique, de K(I). En particulier, lorsque I = [1, n ], la base canonique de Kn est constituée des n vecteurs suivants: De même, l’espace vectoriel K[X] = K(N) des polynômes à une indéterminée à coefficients dans K a pour base canonique la famille des monômes e n = Xn , où n parcourt N.Soit S une partie de E. On dit que S est une partie génératrice, une partie libre ou une partie basique si la famille (x s )s size=1捻 S, où, pour tout élément s de S, x s = s , est une famille génératrice, une famille libre ou une base.Pour qu’une partie à un seul élément x soit libre, il faut et il suffit que le vecteur x soit non nul. Lorsqu’une partiex , y à deux éléments n’est pas libre, on dit aussi que les vecteurs x et y sont colinéaires.La notion de base permet d’exprimer sous la forme suivante la propriété universelle de l’espace vectoriel K(I) énoncée dans le théorème 5.Théorème 6. Soit E et F deux espaces vectoriels sur K, et (e j )j size=1捻 J une famille d’éléments de E. Si cette famille est génératrice, deux applications linéaires de E dans F prenant pour tout j 捻 J la même valeur sur le vecteur e j sont égales. Si cette famille est une base de E, pour toute famille (f j )j size=1捻J d’éléments de F, il existe une application linéaire U et une seule de E dans F telle que, pour tout j 捻 J, U(e j ) = f j . À tout vecteur x de E décomposé dans la base B sous la forme:

De même, l’espace vectoriel K[X] = K(N) des polynômes à une indéterminée à coefficients dans K a pour base canonique la famille des monômes e n = Xn , où n parcourt N.Soit S une partie de E. On dit que S est une partie génératrice, une partie libre ou une partie basique si la famille (x s )s size=1捻 S, où, pour tout élément s de S, x s = s , est une famille génératrice, une famille libre ou une base.Pour qu’une partie à un seul élément x soit libre, il faut et il suffit que le vecteur x soit non nul. Lorsqu’une partiex , y à deux éléments n’est pas libre, on dit aussi que les vecteurs x et y sont colinéaires.La notion de base permet d’exprimer sous la forme suivante la propriété universelle de l’espace vectoriel K(I) énoncée dans le théorème 5.Théorème 6. Soit E et F deux espaces vectoriels sur K, et (e j )j size=1捻 J une famille d’éléments de E. Si cette famille est génératrice, deux applications linéaires de E dans F prenant pour tout j 捻 J la même valeur sur le vecteur e j sont égales. Si cette famille est une base de E, pour toute famille (f j )j size=1捻J d’éléments de F, il existe une application linéaire U et une seule de E dans F telle que, pour tout j 捻 J, U(e j ) = f j . À tout vecteur x de E décomposé dans la base B sous la forme: l’application U associe le vecteur:

l’application U associe le vecteur: Nous pouvons maintenant caractériser les applications linéaires injectives et surjectives à l’aide de la transformée d’une base.Soit E et F deux espaces vectoriels sur K, soit U une application linéaire de E dans F, et (e j )j size=1捻 J une base de E. Pour que U soit surjective (resp. injective), il faut et il suffit que la famille (U(e j ))j size=1捻 J soit génératrice (resp. libre). Pour que U soit bijective, il faut et il suffit que (U(e j ))j size=1捻 J soit une base de F.Lorsque F = K, le théorème 6 se particularise de la manière suivante.Théorème 7. Soit E un espace vectoriel sur K, et B = (e j )j size=1捻 J une base de E. Pour toute famille ( 見j )j size=1捻 J de scalaires, il existe une forme linéaire y et une seule sur E telle que, pour tout j 捻 J, 麗y , e j 礪 = 見j . À tout vecteur x de E décomposé dans la base B sous la forme:

Nous pouvons maintenant caractériser les applications linéaires injectives et surjectives à l’aide de la transformée d’une base.Soit E et F deux espaces vectoriels sur K, soit U une application linéaire de E dans F, et (e j )j size=1捻 J une base de E. Pour que U soit surjective (resp. injective), il faut et il suffit que la famille (U(e j ))j size=1捻 J soit génératrice (resp. libre). Pour que U soit bijective, il faut et il suffit que (U(e j ))j size=1捻 J soit une base de F.Lorsque F = K, le théorème 6 se particularise de la manière suivante.Théorème 7. Soit E un espace vectoriel sur K, et B = (e j )j size=1捻 J une base de E. Pour toute famille ( 見j )j size=1捻 J de scalaires, il existe une forme linéaire y et une seule sur E telle que, pour tout j 捻 J, 麗y , e j 礪 = 見j . À tout vecteur x de E décomposé dans la base B sous la forme: la forme linéaire y associe le scalaire:

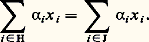

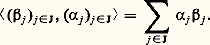

la forme linéaire y associe le scalaire: De plus, l’application ( 見j )j size=1捻 J 料 y est un isomorphisme de l’espace vectoriel KJ sur l’espace vectoriel E.Ainsi, le dual de K(J) s’identifie à KJ, l’application bilinéaire canonique étant définie par la formule:

De plus, l’application ( 見j )j size=1捻 J 料 y est un isomorphisme de l’espace vectoriel KJ sur l’espace vectoriel E.Ainsi, le dual de K(J) s’identifie à KJ, l’application bilinéaire canonique étant définie par la formule: 3. Existence de basesThéorème 8. Soit E un espace vectoriel sur K, soit L une partie libre de E, et S une partie génératrice de E contenant L. Il existe alors une partie basique B de E telle que L 說 B 說 S.Nous allons démontrer ce théorème lorsque la partie S est finie.Introduisons l’ensemble 劉 ordonné par inclusion des parties libres T de E telles que L 說 T 說 S. L’ensemble 劉 est non vide, puisque L appartient à 劉. La partie S étant finie, l’ensemble card(T) des entiers naturels, où T parcourt 劉, admet un plus grand élément p . Soit B un élément de 劉 ayant p éléments. Montrons que B convient. Puisque B appartient à 劉, la partie B est libre, et L 說 B 說 S. Il reste donc à prouver que B est génératrice. Supposons en effet par l’absurde que le sous-espace vectoriel E engendré par B ne soit pas égal à E. Puisque S est génératrice, il existe un élément x de S n’appartenant pas à E , ce qui implique que B = B 聆x est encore libre. Ainsi, B est un élément de 劉 ayant p + 1 éléments, ce qui contredit la définition de p .Lorsque S est quelconque, la démonstration est analogue, le principe de récurrence étant remplacé par le théorème de Zorn.Corollaire 1. Pour toute partie libre L de E, il existe une partie basique B de E contenant L; pour toute partie génératrice S de E, il existe une partie basique B de E contenue dans S. En particulier, pour tout espace vectoriel E sur K, l’ensemble des bases de E est non vide.Ce corollaire s’obtient en spécialisant le théorème aux trois cas suivants: S = E, L = size=1歷, S = E et L = size=1歷.Corollaire 2 (théorème de la base incomplète). Pour toute partie libre L de E et pour toute partie génératrice S de E, il existe une partie S de S telle que L 惡 S soit vide et que B = L 聆 S soit une partie basique de E.Voici l’une des principales conséquences du théorème précédent:Théorème 9. Tout sous-espace vectoriel E d’un espace vectoriel E admet un sous-espace vectoriel supplémentaire dans E.On choisit en effet une partie basique B de E , que l’on complète en une partie basique B de E. Alors le sous-espace vectoriel engendré par B = B 漣 B est un sous-espace vectoriel supplémentaire de E dans E.Corollaire 1. Soit E et F deux espaces vectoriels sur K, soit E un sous-espace vectoriel de E, et U une application linéaire de E dans F. Il existe alors une application linéaire U de E dans F prolongeant U .Corollaire 2. Soit E et F deux espaces vectoriels sur K, soit F un sous-espace vectoriel de F, et 﨏 l’application linéaire canonique de F sur F/F . Pour toute application linéaire U de E dans F/F , il existe une application linéaire V de E dans F telle que U = 﨏 獵 V.Corollaire 3. Soit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F. Pour que U soit surjective, il faut et il suffit que U soit inversible à droite, c’est-à-dire qu’il existe une application linéaire V de F dans E telle que U 獵 V = IF. Pour que U soit injective, il faut et il suffit que U soit inversible à gauche, c’est-à-dire qu’il existe une application linéaire V de F dans E telle que V 獵 U = IE.En effet, il est évident que, si U est inversible à droite (resp. à gauche), U est surjective (resp. injective). Réciproquement, si U est surjective, U définit un isomorphisme U d’un supplémentaire E de Ker(U) sur F; il suffit de prendre pour V l’application linéaire de F dans E coïncidant avec U -1. De même, si U est injective, U définit un isomorphisme U de E sur Im(U); il suffit alors de prendre pour V l’application linéaire nulle sur un supplémentaire F de Im(U), et coïncidant avec U -1 sur Im(U).4. Espaces vectoriels de dimension finieDéfinitionOn dit qu’un espace vectoriel E sur K est de dimension finie sur K, ou, plus simplement, de dimension finie, s’il existe une partie génératrice finie de E. Dans le cas contraire, on dit que E est de dimension infinie.Pour qu’un espace vectoriel E soit de dimension finie, il faut et il suffit qu’il existe une partie basique finie de E, puisque de toute partie génératrice on peut extraire une partie basique.Théorème 10. Soit E un espace vectoriel de dimension finie sur K, et B une partie basique finie de E ayant n éléments. Alors toute partie libre L de E est finie, et le nombre p d’éléments de L est inférieur ou égal à n . De plus, on peut compléter L en une partie basique de E en lui adjoignant (n 漣 p ) éléments convenablement choisis dans B.Le théorème se démontre en utilisant le lemme d’échange suivant, qui fournit en outre un procédé pratique de complétion de L en une partie basique.Lemme. Soit B = (e 1, e 2, ..., e n ) une base de E, soit q un entier inférieur ou égal à n , et Lq = (f 1, f 2, ..., f q ) une famille libre de E. On suppose que B q = (f 1, f 2, ..., f q-1 , e q , ..., e n ) est une base de E. Alors il existe au moins un entier i 捻 [q , n ] tel qu’en substituant f q à e i dans Bq on obtienne encore une base de E, notée Bq+1 .Il suffit pour cela de décomposer f q dans la base Bq . Puisque Lq est libre, il existe au moins un entier i 捻 [q , n ] tel que la i -ième composante de f q soit non nulle. Il est alors immédiat que cet entier i convient.Corollaire 1. Soit E un espace vectoriel de dimension finie sur K. Toutes les parties basiques de E sont finies, et elles ont le même nombre d’éléments.Il résulte en effet du théorème 10 que toutes les parties basiques de E sont finies. Soit donc B et B deux parties basiques de E, ayant respectivement n et n éléments. Comme B est basique et que B est libre, n 諒 n ; de même, n 諒 n , et finalement n = n .Le cardinal commun à toutes les parties basiques de E s’appelle dimension de E sur K, et se note dimKE, ou, plus simplement, dim E. L’espace vectoriel réduit au vecteur nul est le seul espace vectoriel de dimension 0. Un espace vectoriel de dimension 1 s’appelle une droite , un espace vectoriel de dimension 2 s’appelle un plan.Voici quelques exemples:Soit I un ensemble non vide. L’espace vectoriel K(I) est de dimension finie si et seulement si I est fini, et la dimension de K(I) est alors égale à card(I). En particulier, pour tout entier naturel non nul n , Kn est de dimension n .Soit E et F deux espaces vectoriels sur K non réduits à0, soit B = (e j )j size=1捻 J une base de E, et B = (f i )i size=1捻 I une base de F. Pour tout élément (i , j ) de I 憐 J, désignons par Uij l’unique application linéaire de E dans F telle que, pour tout élément k de J,

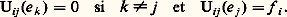

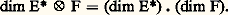

3. Existence de basesThéorème 8. Soit E un espace vectoriel sur K, soit L une partie libre de E, et S une partie génératrice de E contenant L. Il existe alors une partie basique B de E telle que L 說 B 說 S.Nous allons démontrer ce théorème lorsque la partie S est finie.Introduisons l’ensemble 劉 ordonné par inclusion des parties libres T de E telles que L 說 T 說 S. L’ensemble 劉 est non vide, puisque L appartient à 劉. La partie S étant finie, l’ensemble card(T) des entiers naturels, où T parcourt 劉, admet un plus grand élément p . Soit B un élément de 劉 ayant p éléments. Montrons que B convient. Puisque B appartient à 劉, la partie B est libre, et L 說 B 說 S. Il reste donc à prouver que B est génératrice. Supposons en effet par l’absurde que le sous-espace vectoriel E engendré par B ne soit pas égal à E. Puisque S est génératrice, il existe un élément x de S n’appartenant pas à E , ce qui implique que B = B 聆x est encore libre. Ainsi, B est un élément de 劉 ayant p + 1 éléments, ce qui contredit la définition de p .Lorsque S est quelconque, la démonstration est analogue, le principe de récurrence étant remplacé par le théorème de Zorn.Corollaire 1. Pour toute partie libre L de E, il existe une partie basique B de E contenant L; pour toute partie génératrice S de E, il existe une partie basique B de E contenue dans S. En particulier, pour tout espace vectoriel E sur K, l’ensemble des bases de E est non vide.Ce corollaire s’obtient en spécialisant le théorème aux trois cas suivants: S = E, L = size=1歷, S = E et L = size=1歷.Corollaire 2 (théorème de la base incomplète). Pour toute partie libre L de E et pour toute partie génératrice S de E, il existe une partie S de S telle que L 惡 S soit vide et que B = L 聆 S soit une partie basique de E.Voici l’une des principales conséquences du théorème précédent:Théorème 9. Tout sous-espace vectoriel E d’un espace vectoriel E admet un sous-espace vectoriel supplémentaire dans E.On choisit en effet une partie basique B de E , que l’on complète en une partie basique B de E. Alors le sous-espace vectoriel engendré par B = B 漣 B est un sous-espace vectoriel supplémentaire de E dans E.Corollaire 1. Soit E et F deux espaces vectoriels sur K, soit E un sous-espace vectoriel de E, et U une application linéaire de E dans F. Il existe alors une application linéaire U de E dans F prolongeant U .Corollaire 2. Soit E et F deux espaces vectoriels sur K, soit F un sous-espace vectoriel de F, et 﨏 l’application linéaire canonique de F sur F/F . Pour toute application linéaire U de E dans F/F , il existe une application linéaire V de E dans F telle que U = 﨏 獵 V.Corollaire 3. Soit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F. Pour que U soit surjective, il faut et il suffit que U soit inversible à droite, c’est-à-dire qu’il existe une application linéaire V de F dans E telle que U 獵 V = IF. Pour que U soit injective, il faut et il suffit que U soit inversible à gauche, c’est-à-dire qu’il existe une application linéaire V de F dans E telle que V 獵 U = IE.En effet, il est évident que, si U est inversible à droite (resp. à gauche), U est surjective (resp. injective). Réciproquement, si U est surjective, U définit un isomorphisme U d’un supplémentaire E de Ker(U) sur F; il suffit de prendre pour V l’application linéaire de F dans E coïncidant avec U -1. De même, si U est injective, U définit un isomorphisme U de E sur Im(U); il suffit alors de prendre pour V l’application linéaire nulle sur un supplémentaire F de Im(U), et coïncidant avec U -1 sur Im(U).4. Espaces vectoriels de dimension finieDéfinitionOn dit qu’un espace vectoriel E sur K est de dimension finie sur K, ou, plus simplement, de dimension finie, s’il existe une partie génératrice finie de E. Dans le cas contraire, on dit que E est de dimension infinie.Pour qu’un espace vectoriel E soit de dimension finie, il faut et il suffit qu’il existe une partie basique finie de E, puisque de toute partie génératrice on peut extraire une partie basique.Théorème 10. Soit E un espace vectoriel de dimension finie sur K, et B une partie basique finie de E ayant n éléments. Alors toute partie libre L de E est finie, et le nombre p d’éléments de L est inférieur ou égal à n . De plus, on peut compléter L en une partie basique de E en lui adjoignant (n 漣 p ) éléments convenablement choisis dans B.Le théorème se démontre en utilisant le lemme d’échange suivant, qui fournit en outre un procédé pratique de complétion de L en une partie basique.Lemme. Soit B = (e 1, e 2, ..., e n ) une base de E, soit q un entier inférieur ou égal à n , et Lq = (f 1, f 2, ..., f q ) une famille libre de E. On suppose que B q = (f 1, f 2, ..., f q-1 , e q , ..., e n ) est une base de E. Alors il existe au moins un entier i 捻 [q , n ] tel qu’en substituant f q à e i dans Bq on obtienne encore une base de E, notée Bq+1 .Il suffit pour cela de décomposer f q dans la base Bq . Puisque Lq est libre, il existe au moins un entier i 捻 [q , n ] tel que la i -ième composante de f q soit non nulle. Il est alors immédiat que cet entier i convient.Corollaire 1. Soit E un espace vectoriel de dimension finie sur K. Toutes les parties basiques de E sont finies, et elles ont le même nombre d’éléments.Il résulte en effet du théorème 10 que toutes les parties basiques de E sont finies. Soit donc B et B deux parties basiques de E, ayant respectivement n et n éléments. Comme B est basique et que B est libre, n 諒 n ; de même, n 諒 n , et finalement n = n .Le cardinal commun à toutes les parties basiques de E s’appelle dimension de E sur K, et se note dimKE, ou, plus simplement, dim E. L’espace vectoriel réduit au vecteur nul est le seul espace vectoriel de dimension 0. Un espace vectoriel de dimension 1 s’appelle une droite , un espace vectoriel de dimension 2 s’appelle un plan.Voici quelques exemples:Soit I un ensemble non vide. L’espace vectoriel K(I) est de dimension finie si et seulement si I est fini, et la dimension de K(I) est alors égale à card(I). En particulier, pour tout entier naturel non nul n , Kn est de dimension n .Soit E et F deux espaces vectoriels sur K non réduits à0, soit B = (e j )j size=1捻 J une base de E, et B = (f i )i size=1捻 I une base de F. Pour tout élément (i , j ) de I 憐 J, désignons par Uij l’unique application linéaire de E dans F telle que, pour tout élément k de J, Les applications linéaires Uij constituent une base de l’espace vectoriel 硫(E, F), dite associée aux bases B et B . En particulier, si E et F sont de dimension finie, il en est de même de 硫(E, F), et:

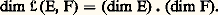

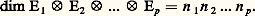

Les applications linéaires Uij constituent une base de l’espace vectoriel 硫(E, F), dite associée aux bases B et B . En particulier, si E et F sont de dimension finie, il en est de même de 硫(E, F), et: (Notons que cette formule reste valable si E ou F est réduit à0.)Plus particulièrement encore, l’espace vectoriel des endomorphismes de E est de dimension finie, et:

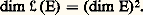

(Notons que cette formule reste valable si E ou F est réduit à0.)Plus particulièrement encore, l’espace vectoriel des endomorphismes de E est de dimension finie, et: Soit E un espace vectoriel sur K non réduit à0, et B = (e j )j size=1捻 J une base de E. Pour tout élément i de J, l’unique forme linéaire e i telle que, pour tout élément j de J:

Soit E un espace vectoriel sur K non réduit à0, et B = (e j )j size=1捻 J une base de E. Pour tout élément i de J, l’unique forme linéaire e i telle que, pour tout élément j de J: s’appelle i -ième forme linéaire coordonnée. La famille (e j )j size=1捻 J des formes linéaires coordonnées est libre; pour que ce soit une base de E, il faut et il suffit que E soit de dimension finie. Cette base s’appelle base duale de la base B, et se note B. Nous voyons ainsi que l’espace vectoriel dual de E est de dimension finie si et seulement si E est de dimension finie, et que, dans ces conditions:

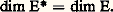

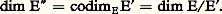

s’appelle i -ième forme linéaire coordonnée. La famille (e j )j size=1捻 J des formes linéaires coordonnées est libre; pour que ce soit une base de E, il faut et il suffit que E soit de dimension finie. Cette base s’appelle base duale de la base B, et se note B. Nous voyons ainsi que l’espace vectoriel dual de E est de dimension finie si et seulement si E est de dimension finie, et que, dans ces conditions: Corollaire 2. Pour que deux espaces vectoriels de dimension finie sur K soient isomorphes, il faut et il suffit qu’ils aient même dimension.Corollaire 3. Soit E un espace vectoriel de dimension finie n sur K, et S une partie génératrice finie de E. Alors le nombre p d’éléments de S est supérieur ou égal à n . De plus, il existe une partie basique de E constituée de n vecteurs convenablement choisis dans S.Corollaire 4. Soit E un espace vectoriel de dimension finie n sur K. Toute partie libre de E ayant n éléments est une partie basique de E, et toute partie génératrice de E ayant n éléments est une partie basique de E.Dimension et codimension d’un sous-espace vectorielSoit E un espace vectoriel sur K. On dit qu’un sous-espace vectoriel E de E est de codimension finie dans E si l’espace vectoriel quotient E/E est de dimension finie. La dimension de E/E s’appelle alors codimension de E dans E, et se note codimEE . Les sous-espaces vectoriels de codimension 1 dans E s’appellent hyperplans de E.Pour qu’un sous-espace vectoriel E de E soit de codimension finie dans E, il faut et il suffit que E admette un sous-espace vectoriel supplémentaire de dimension finie. Alors, pour tout sous-espace vectoriel E supplémentaire de E dans E:

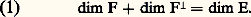

Corollaire 2. Pour que deux espaces vectoriels de dimension finie sur K soient isomorphes, il faut et il suffit qu’ils aient même dimension.Corollaire 3. Soit E un espace vectoriel de dimension finie n sur K, et S une partie génératrice finie de E. Alors le nombre p d’éléments de S est supérieur ou égal à n . De plus, il existe une partie basique de E constituée de n vecteurs convenablement choisis dans S.Corollaire 4. Soit E un espace vectoriel de dimension finie n sur K. Toute partie libre de E ayant n éléments est une partie basique de E, et toute partie génératrice de E ayant n éléments est une partie basique de E.Dimension et codimension d’un sous-espace vectorielSoit E un espace vectoriel sur K. On dit qu’un sous-espace vectoriel E de E est de codimension finie dans E si l’espace vectoriel quotient E/E est de dimension finie. La dimension de E/E s’appelle alors codimension de E dans E, et se note codimEE . Les sous-espaces vectoriels de codimension 1 dans E s’appellent hyperplans de E.Pour qu’un sous-espace vectoriel E de E soit de codimension finie dans E, il faut et il suffit que E admette un sous-espace vectoriel supplémentaire de dimension finie. Alors, pour tout sous-espace vectoriel E supplémentaire de E dans E: Théorème 11. Soit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F.1. Si F est de dimension finie et si U est injective, alors E est de dimension finie, et dim E 諒 dim F. En particulier, tout sous-espace vectoriel F d’un espace vectoriel F de dimension finie est aussi de dimension finie, et dim F 諒 dim F.2. Si E est de dimension finie et si U est surjective, alors F est de dimension finie, et dim F 諒 dim E. En particulier, tout sous-espace vectoriel E d’un espace vectoriel E de dimension finie est de codimension finie dans E, et:

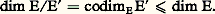

Théorème 11. Soit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F.1. Si F est de dimension finie et si U est injective, alors E est de dimension finie, et dim E 諒 dim F. En particulier, tout sous-espace vectoriel F d’un espace vectoriel F de dimension finie est aussi de dimension finie, et dim F 諒 dim F.2. Si E est de dimension finie et si U est surjective, alors F est de dimension finie, et dim F 諒 dim E. En particulier, tout sous-espace vectoriel E d’un espace vectoriel E de dimension finie est de codimension finie dans E, et: Soit en effet B une partie basique de E, et B une partie basique de E .Si U est injective, card(U(B)) = card(B), et U(B) est une partie libre de F. Il résulte du théorème 10 que card(U(B)) 諒 card(B ). L’assertion 1 en découle, puisque F est de dimension finie. Le cas particulier s’en déduit en prenant pour E un sous-espace vectoriel F de F, et pour U l’injection canonique de F dans F.Si U est surjective, U(B) est une partie génératrice de F; d’autre part, card (U(B)) 諒 card(B). Il résulte du corollaire 4 du théorème 10 que card(B ) 諒 card(U(B)). L’assertion 2 en découle, puisque E est de dimension finie. Le cas particulier s’en déduit en prenant pour F l’espace vectoriel quotient E/E , et pour U l’application linéaire canonique de E sur E/E .Corollaire . Soit E un espace vectoriel de dimension finie sur K, et E un sous-espace vectoriel de E. Alors la dimension de tous les sous-espaces vectoriels supplémentaires de E dans E est égale à dim E 漣 dim E . De plus:

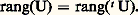

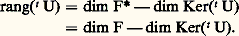

Soit en effet B une partie basique de E, et B une partie basique de E .Si U est injective, card(U(B)) = card(B), et U(B) est une partie libre de F. Il résulte du théorème 10 que card(U(B)) 諒 card(B ). L’assertion 1 en découle, puisque F est de dimension finie. Le cas particulier s’en déduit en prenant pour E un sous-espace vectoriel F de F, et pour U l’injection canonique de F dans F.Si U est surjective, U(B) est une partie génératrice de F; d’autre part, card (U(B)) 諒 card(B). Il résulte du corollaire 4 du théorème 10 que card(B ) 諒 card(U(B)). L’assertion 2 en découle, puisque E est de dimension finie. Le cas particulier s’en déduit en prenant pour F l’espace vectoriel quotient E/E , et pour U l’application linéaire canonique de E sur E/E .Corollaire . Soit E un espace vectoriel de dimension finie sur K, et E un sous-espace vectoriel de E. Alors la dimension de tous les sous-espaces vectoriels supplémentaires de E dans E est égale à dim E 漣 dim E . De plus: En particulier, pour que E = E, il faut et il suffit que dim E = dim E. De même, les hyperplans d’un espace vectoriel de dimension n ne sont autres que les sous-espaces vectoriels de dimension n 漣 1.Rang d’une application linéaireSoit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F. On dit que U est de rang fini si l’image de U est un espace vectoriel de dimension finie. La dimension de Im(U) s’appelle alors rang de l’application linéaire U, et se note rang(U).Théorème 12 . Pour que l’application linéaire U soit de rang fini, il faut et il suffit que le noyau de U soit de codimension finie dans E. Le rang de U est alors égal à la codimension dans E du noyau de U:

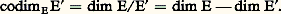

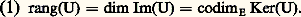

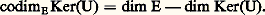

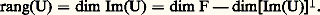

En particulier, pour que E = E, il faut et il suffit que dim E = dim E. De même, les hyperplans d’un espace vectoriel de dimension n ne sont autres que les sous-espaces vectoriels de dimension n 漣 1.Rang d’une application linéaireSoit E et F deux espaces vectoriels sur K, et U une application linéaire de E dans F. On dit que U est de rang fini si l’image de U est un espace vectoriel de dimension finie. La dimension de Im(U) s’appelle alors rang de l’application linéaire U, et se note rang(U).Théorème 12 . Pour que l’application linéaire U soit de rang fini, il faut et il suffit que le noyau de U soit de codimension finie dans E. Le rang de U est alors égal à la codimension dans E du noyau de U: En effet, l’espace vectoriel quotient E/Ker(U) est isomorphe à l’espace vectoriel Im(U).Si F est de dimension finie, toute application linéaire U de E dans F est de rang fini, car Im(U), étant un sous-espace vectoriel de F, est de dimension finie.Si E est de dimension finie, toute application linéaire U de E dans F est de dimension finie, et l’on a la formule de la dimension:

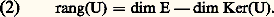

En effet, l’espace vectoriel quotient E/Ker(U) est isomorphe à l’espace vectoriel Im(U).Si F est de dimension finie, toute application linéaire U de E dans F est de rang fini, car Im(U), étant un sous-espace vectoriel de F, est de dimension finie.Si E est de dimension finie, toute application linéaire U de E dans F est de dimension finie, et l’on a la formule de la dimension: En effet, U définissant une application linéaire surjective de E sur Im(U), l’espace vectoriel Im(U) est de dimension finie. La formule (2) est alors une conséquence de la formule (1) et de la suivante:

En effet, U définissant une application linéaire surjective de E sur Im(U), l’espace vectoriel Im(U) est de dimension finie. La formule (2) est alors une conséquence de la formule (1) et de la suivante: Lorsque les espaces vectoriels E et F sont tous deux de dimension finie, et qu’ils ont même dimension n , il est équivalent de dire:– L’application linéaire U est un isomorphisme de E sur F;– L’application linéaire U est inversible à droite;– L’application linéaire U est inversible à gauche;– L’application linéaire U est bijective;– L’application linéaire U est surjective;– L’application linéaire U est injective;– Le rang de U est égal à n .Dualité en dimension finieThéorème 13 . Soit E un espace vectoriel de dimension finie sur K. Alors l’application linéaire canonique 﨑 de E dans son bidual E est un isomorphisme.

Lorsque les espaces vectoriels E et F sont tous deux de dimension finie, et qu’ils ont même dimension n , il est équivalent de dire:– L’application linéaire U est un isomorphisme de E sur F;– L’application linéaire U est inversible à droite;– L’application linéaire U est inversible à gauche;– L’application linéaire U est bijective;– L’application linéaire U est surjective;– L’application linéaire U est injective;– Le rang de U est égal à n .Dualité en dimension finieThéorème 13 . Soit E un espace vectoriel de dimension finie sur K. Alors l’application linéaire canonique 﨑 de E dans son bidual E est un isomorphisme. Choisissons une base B = (e j )1 size=1諒j size=1諒 n de E. En prenant successivement pour y les n formes linéaires coordonnées e i , nous voyons que toutes les composantes de x sont nulles, et donc que x = 0, ce qui montre que l’application linéaire 﨑 est injective. Comme:

Choisissons une base B = (e j )1 size=1諒j size=1諒 n de E. En prenant successivement pour y les n formes linéaires coordonnées e i , nous voyons que toutes les composantes de x sont nulles, et donc que x = 0, ce qui montre que l’application linéaire 﨑 est injective. Comme: la formule de la dimension permet d’en déduire que 﨑 est un isomorphisme de E sur E.Il découle de ce théorème que l’application qui à toute base B de E associe sa base duale B est une bijection de l’ensemble des bases de E sur l’ensemble des bases de E.On peut maintenant préciser les propriétés de l’orthogonalité en dimension finie.Théorème 14 . Soit E un espace vectoriel de dimension finie sur K, et E son dual.Pour tout sous-espace vectoriel F de E:

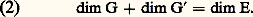

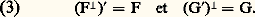

la formule de la dimension permet d’en déduire que 﨑 est un isomorphisme de E sur E.Il découle de ce théorème que l’application qui à toute base B de E associe sa base duale B est une bijection de l’ensemble des bases de E sur l’ensemble des bases de E.On peut maintenant préciser les propriétés de l’orthogonalité en dimension finie.Théorème 14 . Soit E un espace vectoriel de dimension finie sur K, et E son dual.Pour tout sous-espace vectoriel F de E: Pour tout sous-espace vectoriel G de E:

Pour tout sous-espace vectoriel G de E: De plus:

De plus: Considérons en effet une base (e 1, e 2, ..., e p ) de F, et complétons-la en une base (e 1, e 2, ..., e n ) de E; soit (e 1, e 2, ..., e n ) sa base duale. Pour établir la formule (1), il suffit de prouver que (e p+1 , e p+2 , ..., e n ) est une base de F size=1旅. Les formes linéaires coordonnées e p+1 , e p+2 , ..., e n , appartiennent évidemment à F size=1旅, car elles sont orthogonales aux vecteurs e 1, e 2, ..., e p , lesquels engendrent F; elles sont linéairement indépendantes, car elles font partie d’une base; enfin, il reste à montrer que tout élément y de F size=1旅 est combinaison linéaire de ces éléments. Écrivons pour cela y sous la forme:

Considérons en effet une base (e 1, e 2, ..., e p ) de F, et complétons-la en une base (e 1, e 2, ..., e n ) de E; soit (e 1, e 2, ..., e n ) sa base duale. Pour établir la formule (1), il suffit de prouver que (e p+1 , e p+2 , ..., e n ) est une base de F size=1旅. Les formes linéaires coordonnées e p+1 , e p+2 , ..., e n , appartiennent évidemment à F size=1旅, car elles sont orthogonales aux vecteurs e 1, e 2, ..., e p , lesquels engendrent F; elles sont linéairement indépendantes, car elles font partie d’une base; enfin, il reste à montrer que tout élément y de F size=1旅 est combinaison linéaire de ces éléments. Écrivons pour cela y sous la forme: Puisque, pour tout élément i de [1, p ], 麗y , e i 礪 = 0, nous voyons que 兀1 = 兀2 = ... = 兀p = 0, ce qui achève la démonstration. La formule (2) s’établit de manière analogue, en tenant compte du fait que toute base de E est la base duale d’une base de E. Enfin, la formule (3) se déduit des relations F 說 (F size=1旅) , G 說 (G ) size=1旅, dim F = dim(F size=1旅) et dim G = dim(G ) size=1旅, ces deux dernières égalités découlant des formules (1) et (2).Théorème 15 . Soit E et F deux espaces vectoriels de dimension finie sur K, soit U une application linéaire de E dans F, et t U sa transposée.Les applications linéaires U et t U ont même rang:

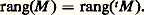

Puisque, pour tout élément i de [1, p ], 麗y , e i 礪 = 0, nous voyons que 兀1 = 兀2 = ... = 兀p = 0, ce qui achève la démonstration. La formule (2) s’établit de manière analogue, en tenant compte du fait que toute base de E est la base duale d’une base de E. Enfin, la formule (3) se déduit des relations F 說 (F size=1旅) , G 說 (G ) size=1旅, dim F = dim(F size=1旅) et dim G = dim(G ) size=1旅, ces deux dernières égalités découlant des formules (1) et (2).Théorème 15 . Soit E et F deux espaces vectoriels de dimension finie sur K, soit U une application linéaire de E dans F, et t U sa transposée.Les applications linéaires U et t U ont même rang: En effet, la formule de la dimension appliquée à t U montre que:

En effet, la formule de la dimension appliquée à t U montre que: D’autre part:

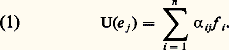

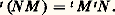

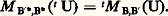

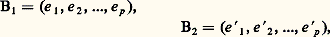

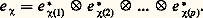

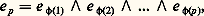

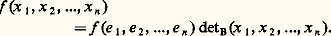

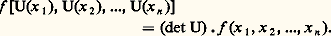

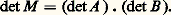

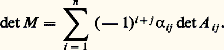

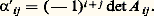

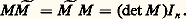

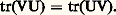

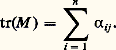

D’autre part: La formule annoncée résulte alors du fait que le noyau de t U n’est autre que l’orthogonal de l’image de U.5. MatricesMatrices et applications linéairesSoit E et F deux espaces vectoriels sur K non réduits à0, de dimensions respectives p et n , soit B = (e 1, e 2, ...., e p ) une base de E, soit B = (f 1, f 2, ..., f n) une base de F et U une application linéaire de E dans F. Pour tout élément j de [1, p ], le vecteur U(e j ) se décompose d’une manière et d’une seule dans la base B sous la forme:

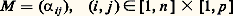

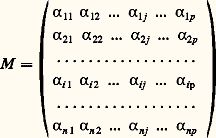

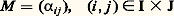

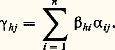

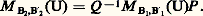

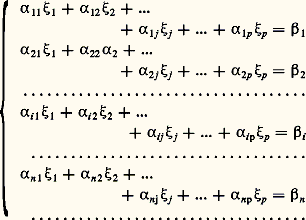

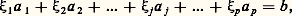

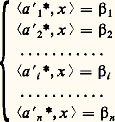

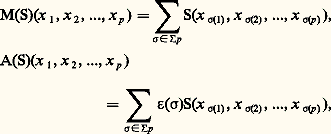

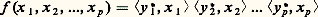

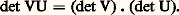

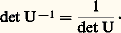

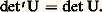

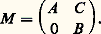

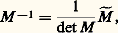

La formule annoncée résulte alors du fait que le noyau de t U n’est autre que l’orthogonal de l’image de U.5. MatricesMatrices et applications linéairesSoit E et F deux espaces vectoriels sur K non réduits à0, de dimensions respectives p et n , soit B = (e 1, e 2, ...., e p ) une base de E, soit B = (f 1, f 2, ..., f n) une base de F et U une application linéaire de E dans F. Pour tout élément j de [1, p ], le vecteur U(e j ) se décompose d’une manière et d’une seule dans la base B sous la forme: Ainsi, à toute application linéaire U de E dans F nous pouvons associer une famille ( 見ij ) d’éléments de K. Réciproquement, pour toute famille ( 見ij ) d’éléments de K, où (i , j ) 捻 [1, n ] 憐 [1, p ], il existe une application linéaire U et une seule de E dans F satisfaisant aux conditions (1).Nous sommes donc amené à introduire les définitions suivantes, utiles pour les calculs explicites concernant les applications linéaires: Soit K un corps commutatif, n et p deux entiers naturels non nuls. On appelle matrice à n lignes et p colonnes à éléments dans K toute famille: